Python爬蟲獲取豆瓣電影并寫入excel

豆瓣電影排行榜前250 分為10頁,第一頁的url為https://movie.douban.com/top250,但實(shí)際上應(yīng)該是https://movie.douban.com/top250?start=0 后面的參數(shù)0表示從第幾個開始,如0表示從第一(肖申克的救贖)到第二十五(觸不可及),https://movie.douban.com/top250?start=25表示從第二十六(蝙蝠俠:黑暗騎士)到第五十名(死亡詩社)。等等,

所以可以用一個步長為25的range的for循環(huán)參數(shù)

復(fù)制代碼 代碼如下:for i in range(0, 250, 25): print(i)

分析完頁面組成后,開始獲取頁面,直接request.get()發(fā)現(xiàn)沒有返回任何東西,輸出一下響應(yīng)碼

url = ’https://movie.douban.com/top250?start=0’res = request.get(url=url)print(res.status_code)

發(fā)現(xiàn)返回響應(yīng)碼418

以前沒見過這個,拉網(wǎng)線上網(wǎng)查一下,發(fā)現(xiàn)給get里面加一個header參數(shù)就行了

這里可以用自己瀏覽器的user-agent,如

headers = {’User-Agent’: ’Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.103 Safari/537.36’}

或者用fake_agent(安裝直接用pip install fake_agent) 來為自己生成一個隨機(jī)的agent添加到header字典中

from fake_useragent import UserAgentheaders = {’User-Agent’: UserAgent().random}

之后就可以得到頁面源碼了。

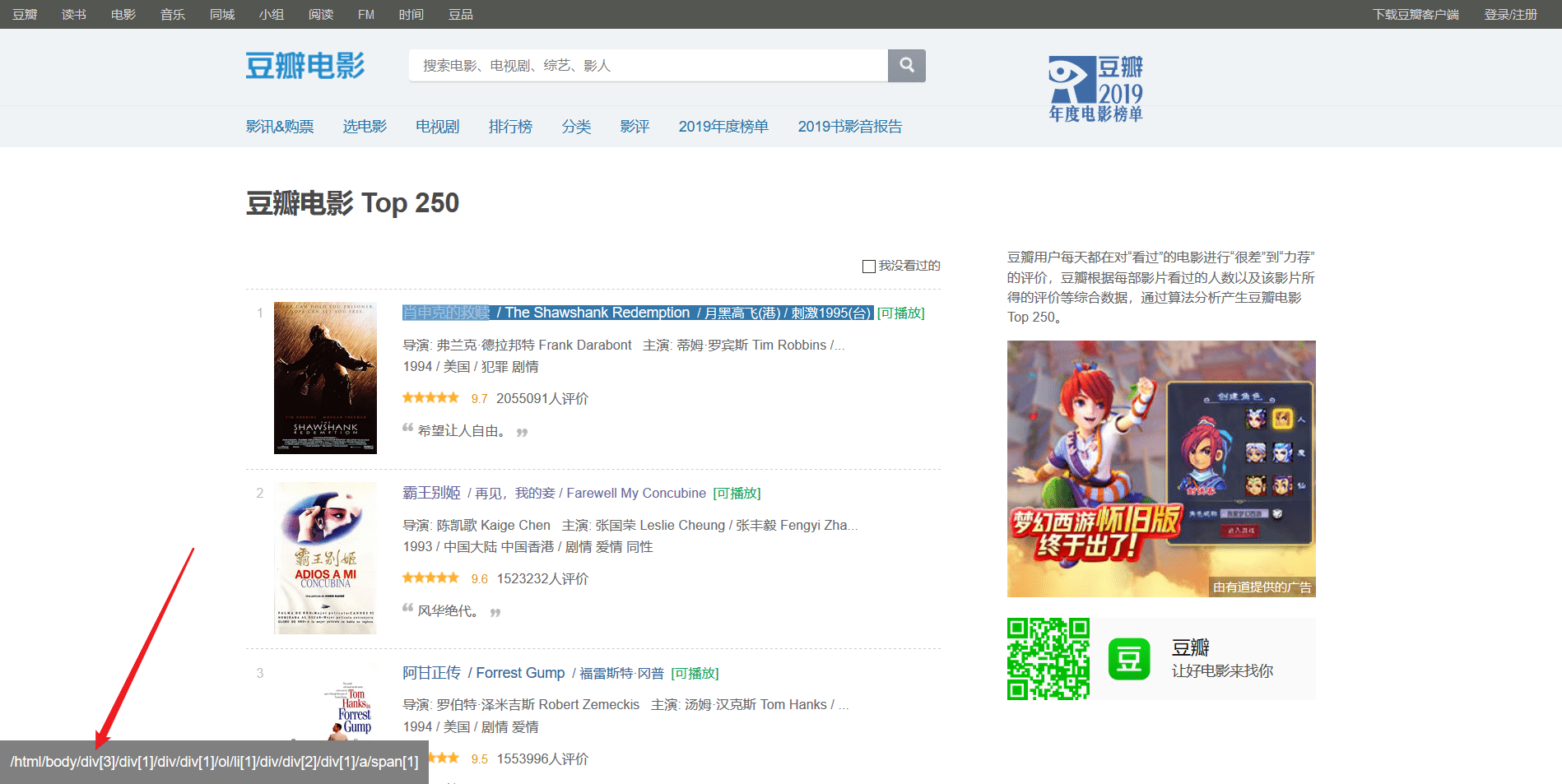

然后使用lxml.etree,即xpath解析頁面源碼。用瀏覽器插件xpath finder快速定位到元素

import requestsimport lxml.etree as etreeurl = ’https://movie.douban.com/top250?start=0’headers = {’User-Agent’: ’Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.103 Safari/537.36’}res = requests.get(url=url, headers=headers)print(res.text)html = etree.HTML(res.text)name = html.xpath('/html/body/div[3]/div[1]/div/div[1]/ol/li[1]/div/div[2]/div[1]/a/span[1]')print(name)

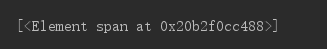

但是直接這樣子,解析到的是這樣的結(jié)果

[<Element span at 0x20b2f0cc488>]

關(guān)于這東西是什么,有文章寫的很好:https://www.jb51.net/article/132145.htm

這里我直接寫解決部分,在使用xpath解析時,后面加上/text()

name = html.xpath('/html/body/div[3]/div[1]/div/div[1]/ol/li[1]/div/div[2]/div[1]/a/span[1]/text()')

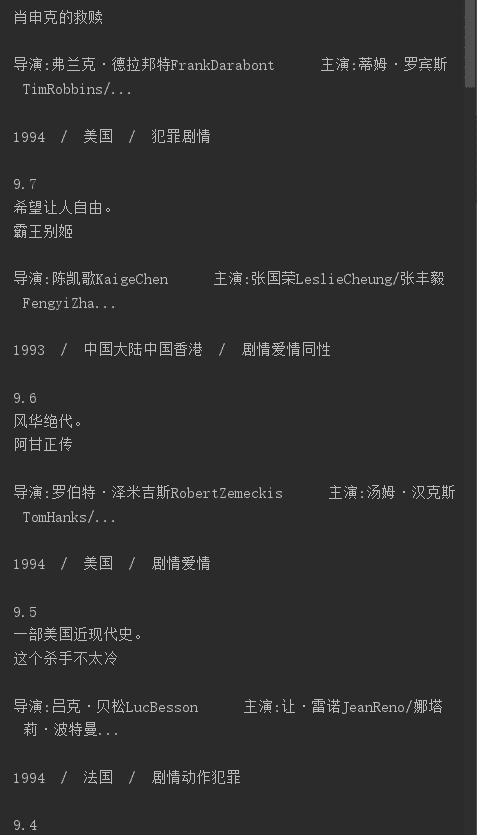

解決后,再使用xpath finder插件,一步一步獲取到電影所有數(shù)據(jù)

最后把這個寫在函數(shù)里,外面再套上一開始說的循環(huán),就OK了

# -*- coding: utf-8 -*-import requestsimport lxml.etree as etreedef get_source(page): url = ’https://movie.douban.com/top250?start={}’.format(page) headers = { ’User-Agent’: ’Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.103 Safari/537.36’} print(url) res = requests.get(url=url, headers=headers) print(res.status_code) html = etree.HTML(res.text) for i in range(1, 26): name = html.xpath('/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[1]/a/span[1]/text()'.format(i)) info = html.xpath('/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[2]/p[1]/text()'.format(i)) score = html.xpath( '/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[2]/div/span[2]/text()'.format(i)) slogan = html.xpath( '/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[2]/p[2]/span/text()'.format(i)) print(name[0]) print(info[0].replace(’ ’, ’’)) print(info[1].replace(’ ’, ’’)) print(score[0]) print(slogan[0])n = 1for i in range(0, 250, 25): print(’第%d頁’ % n) n += 1 get_source(i) print(’==========================================’)

在定位時,發(fā)現(xiàn)有4部電影介紹沒有slogan,導(dǎo)致獲取到的信息為空列表,也就導(dǎo)致了list.append()會出錯。所以我加上了幾個差錯處理,解決方式可能有點(diǎn)傻,如果有更好的解決辦法,洗耳恭聽

代碼在最后可以看到

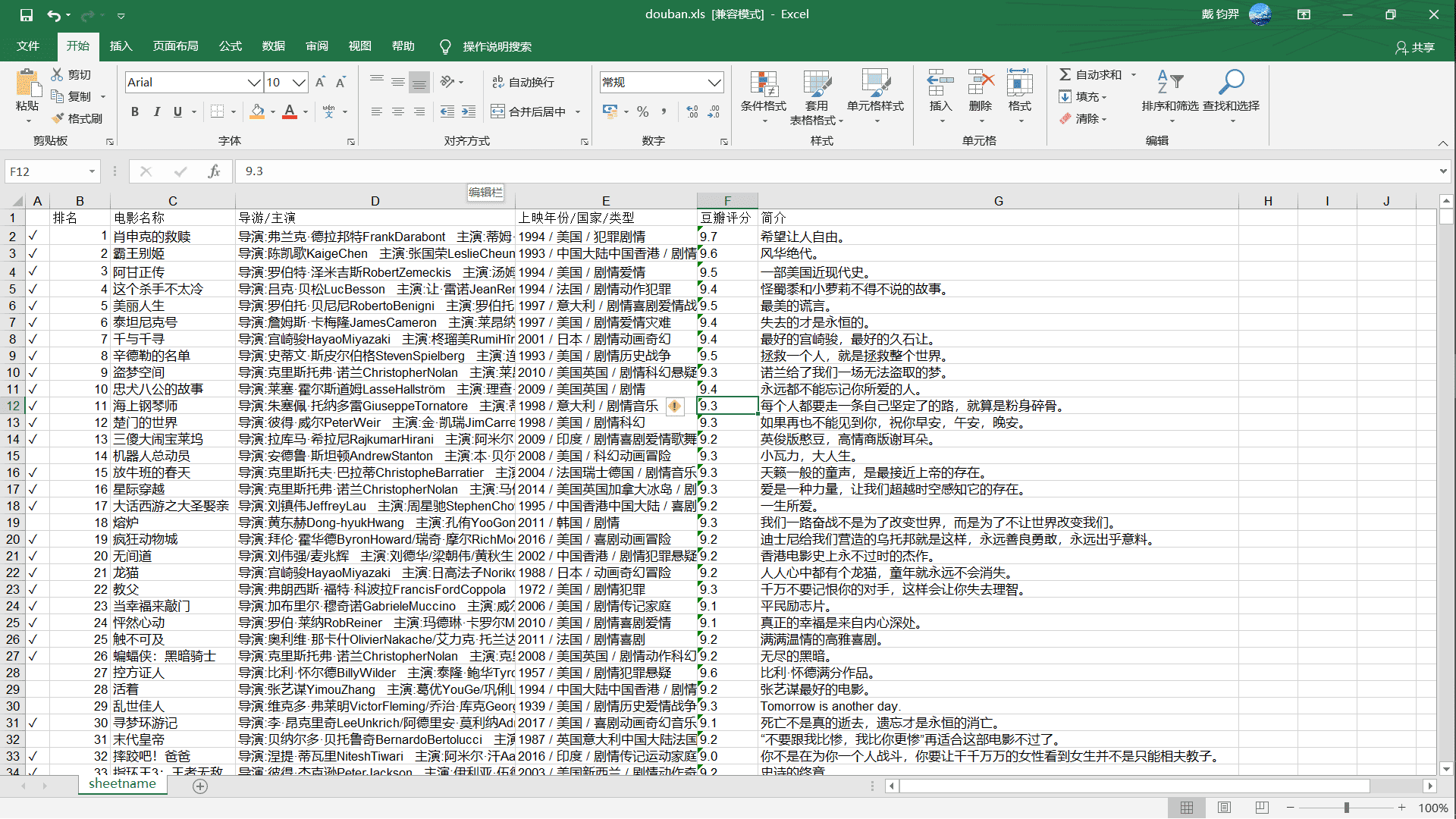

EXCEL保存部分

這里我用的xlwt

book = xlwt.Workbook()

sheet = book.add_sheet(u’sheetname’, cell_overwrite_ok=True)

創(chuàng)建一個sheet表單。

數(shù)據(jù)保存到一個大列表中,列表嵌套列表

再通過循環(huán)把數(shù)據(jù)導(dǎo)入到excel表單中

r = 1 for i in LIST: #有10頁 for j in i: #有25條數(shù)據(jù) c = 2 for x in j: #有5組數(shù)據(jù)print(x)sheet.write(r, c, x)c += 1 r += 1

最后在保存一下

book.save(r’douban.xls’)

注意文件后綴要用xls,用xlsx會導(dǎo)致文件打不開

然后就大功告成了

打開文件,手動加入排名,等部分信息(這些也可以在程序里完成,我嫌麻煩,就沒寫,直接手動來的快)

前面的✓是我自己整的,用于記錄那些看過,那些沒看過

這也是我寫這個東西的最初的目的

完整代碼在下面,僅用于參考

# -*- coding: utf-8 -*-import requestsimport lxml.etree as etreeimport xlwtdef get_source(page): List = [] url = ’https://movie.douban.com/top250?start={}’.format(page) headers = { ’User-Agent’: ’Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.103 Safari/537.36’} print(url) res = requests.get(url=url, headers=headers) print(res.status_code) html = etree.HTML(res.text) for i in range(1, 26): list = [] name = html.xpath('/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[1]/a/span[1]/text()'.format(i)) info = html.xpath('/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[2]/p[1]/text()'.format(i)) score = html.xpath( '/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[2]/div/span[2]/text()'.format(i)) slogan = html.xpath( '/html/body/div[3]/div[1]/div/div[1]/ol/li[{}]/div/div[2]/div[2]/p[2]/span/text()'.format(i)) try: list.append(name[0]) except: list.append(’----’) try: list.append(info[0].replace(’ ’, ’’).replace(’n’, ’’)) except: list.append(’----’) try: list.append(info[1].replace(’ ’, ’’).replace(’n’, ’’)) except: list.append(’----’) try: list.append(score[0]) except: list.append(’----’) try: list.append(slogan[0]) except: list.append(’----’) List.append(list) return Listn = 1LIST = []for i in range(0, 250, 25): print(’第{}頁’.format(n)) n += 1 List = get_source(i) LIST.append(List)def excel_write(LIST): book = xlwt.Workbook() sheet = book.add_sheet(u’sheetname’, cell_overwrite_ok=True) r = 1 for i in LIST: #有10頁 for j in i: #有25條數(shù)據(jù) c = 2 for x in j: #有5組數(shù)據(jù)print(x)sheet.write(r, c, x)c += 1 r += 1 book.save(r’douban1.xls’) #保存代碼excel_write(LIST)

以上就是本文的全部內(nèi)容,希望對大家的學(xué)習(xí)有所幫助,也希望大家多多支持好吧啦網(wǎng)。

相關(guān)文章:

1. Python基于requests庫爬取網(wǎng)站信息2. vscode運(yùn)行php報錯php?not?found解決辦法3. Python使用Selenium自動進(jìn)行百度搜索的實(shí)現(xiàn)4. Java commons-httpclient如果實(shí)現(xiàn)get及post請求5. 一文帶你徹底理解Java序列化和反序列化6. 微信小程序?qū)崿F(xiàn)商品分類頁過程結(jié)束7. PHP laravel實(shí)現(xiàn)導(dǎo)出PDF功能8. JS中6個對象數(shù)組去重的方法9. 資深程序員:給Python軟件開發(fā)測試的25個忠告!10. python中文本字符處理的簡單方法記錄

網(wǎng)公網(wǎng)安備

網(wǎng)公網(wǎng)安備