Docker Compose一鍵ELK部署的方法實現

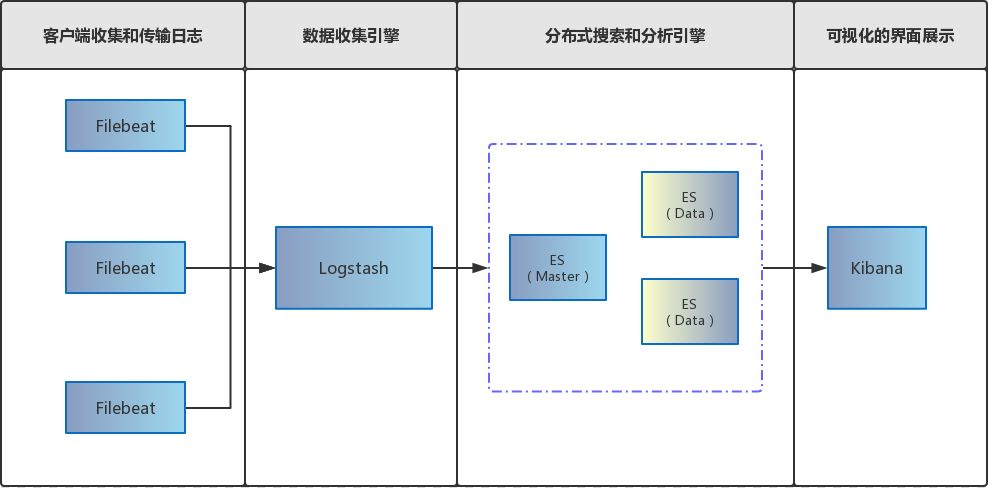

Filebeat 已經完全替代了 Logstash-Forwarder 成為新一代的日志采集器,因為它更加輕量、安全。基于 Filebeat + ELK 的部署方案架構圖如下:

軟件版本:

服務 版本 說明 CentOS 7.6 Docker 18.09.5 Docker Compose 1.25.0 ELK 7.5.1 Filebeat 7.5.1

docker-compose 文件version: '3'services: es-master: container_name: es-master hostname: es-master image: elasticsearch:7.5.1 restart: always ports: - 9200:9200 - 9300:9300 volumes: - ./elasticsearch/master/conf/es-master.yml:/usr/share/elasticsearch/config/elasticsearch.yml - ./elasticsearch/master/data:/usr/share/elasticsearch/data - ./elasticsearch/master/logs:/usr/share/elasticsearch/logs environment: - 'ES_JAVA_OPTS=-Xms512m -Xmx512m' es-slave1: container_name: es-slave1 image: elasticsearch:7.5.1 restart: always ports: - 9201:9200 - 9301:9300 volumes: - ./elasticsearch/slave1/conf/es-slave1.yml:/usr/share/elasticsearch/config/elasticsearch.yml - ./elasticsearch/slave1/data:/usr/share/elasticsearch/data - ./elasticsearch/slave1/logs:/usr/share/elasticsearch/logs environment: - 'ES_JAVA_OPTS=-Xms512m -Xmx512m' es-slave2: container_name: es-slave2 image: elasticsearch:7.5.1 restart: always ports: - 9202:9200 - 9302:9300 volumes: - ./elasticsearch/slave2/conf/es-slave2.yml:/usr/share/elasticsearch/config/elasticsearch.yml - ./elasticsearch/slave2/data:/usr/share/elasticsearch/data - ./elasticsearch/slave2/logs:/usr/share/elasticsearch/logs environment: - 'ES_JAVA_OPTS=-Xms512m -Xmx512m' kibana: container_name: kibana hostname: kibana image: kibana:7.5.1 restart: always ports: - 5601:5601 volumes: - ./kibana/conf/kibana.yml:/usr/share/kibana/config/kibana.yml environment: - elasticsearch.hosts=http://es-master:9200 depends_on: - es-master - es-slave1 - es-slave2 # filebeat: # # 容器名稱 # container_name: filebeat # # 主機名稱 # hostname: filebeat # # 鏡像 # image: docker.elastic.co/beats/filebeat:7.5.1 # # 重啟機制 # restart: always # # 持久化掛載 # volumes: # - ./filebeat/conf/filebeat.yml:/usr/share/filebeat/filebeat.yml # # 映射到容器中[作為數據源] # - ./logs:/home/project/spring-boot-elasticsearch/logs # - ./filebeat/logs:/usr/share/filebeat/logs # - ./filebeat/data:/usr/share/filebeat/data # # 將指定容器連接到當前連接,可以設置別名,避免ip方式導致的容器重啟動態改變的無法連接情況 # links: # - logstash # # 依賴服務[可無] # depends_on: # - es-master # - es-slave1 # - es-slave2 logstash: container_name: logstash hostname: logstash image: logstash:7.5.1 command: logstash -f ./conf/logstash-filebeat.conf restart: always volumes: # 映射到容器中 - ./logstash/conf/logstash-filebeat.conf:/usr/share/logstash/conf/logstash-filebeat.conf - ./logstash/ssl:/usr/share/logstash/ssl environment: - elasticsearch.hosts=http://es-master:9200 # 解決logstash監控連接報錯 - xpack.monitoring.elasticsearch.hosts=http://es-master:9200 ports: - 5044:5044 depends_on: - es-master - es-slave1 - es-slave2

這里把 Filebeat 給注釋掉了,打算在各個需要搜集日志的服務器上面單獨部署 Filebeat。

記得把 Elasticsearch 的 data 和 logs 設置 chmod 777

es-master.yml

# 集群名稱cluster.name: es-cluster# 節點名稱node.name: es-master# 是否可以成為master節點node.master: true# 是否允許該節點存儲數據,默認開啟node.data: false# 網絡綁定network.host: 0.0.0.0# 設置對外服務的http端口http.port: 9200# 設置節點間交互的tcp端口transport.port: 9300# 集群發現discovery.seed_hosts: - es-master - es-slave1 - es-slave2# 手動指定可以成為 mater 的所有節點的 name 或者 ip,這些配置將會在第一次選舉中進行計算cluster.initial_master_nodes: - es-master# 支持跨域訪問http.cors.enabled: truehttp.cors.allow-origin: '*'# 安全認證xpack.security.enabled: false#http.cors.allow-headers: 'Authorization'

es-slave1.yml

# 集群名稱cluster.name: es-cluster# 節點名稱node.name: es-slave1# 是否可以成為master節點node.master: true# 是否允許該節點存儲數據,默認開啟node.data: true# 網絡綁定network.host: 0.0.0.0# 設置對外服務的http端口http.port: 9201# 設置節點間交互的tcp端口#transport.port: 9301# 集群發現discovery.seed_hosts: - es-master - es-slave1 - es-slave2# 手動指定可以成為 mater 的所有節點的 name 或者 ip,這些配置將會在第一次選舉中進行計算cluster.initial_master_nodes: - es-master# 支持跨域訪問http.cors.enabled: truehttp.cors.allow-origin: '*'# 安全認證xpack.security.enabled: false#http.cors.allow-headers: 'Authorization'

es-slave2.yml

# 集群名稱cluster.name: es-cluster# 節點名稱node.name: es-slave2# 是否可以成為master節點node.master: true# 是否允許該節點存儲數據,默認開啟node.data: true# 網絡綁定network.host: 0.0.0.0# 設置對外服務的http端口http.port: 9202# 設置節點間交互的tcp端口#transport.port: 9302# 集群發現discovery.seed_hosts: - es-master - es-slave1 - es-slave2# 手動指定可以成為 mater 的所有節點的 name 或者 ip,這些配置將會在第一次選舉中進行計算cluster.initial_master_nodes: - es-master# 支持跨域訪問http.cors.enabled: truehttp.cors.allow-origin: '*'# 安全認證xpack.security.enabled: false#http.cors.allow-headers: 'Authorization'

logstash-filebeat.conf

input { # 來源beats beats { # 端口 port => '5044' ssl_certificate_authorities => ['/usr/share/logstash/ssl/ca.crt'] ssl_certificate => '/usr/share/logstash/ssl/server.crt' ssl_key => '/usr/share/logstash/ssl/server.key' ssl_verify_mode => 'force_peer' }}# 分析、過濾插件,可以多個filter { grok { match => { 'message' => '%{COMBINEDAPACHELOG}'} } geoip { source => 'clientip' }}output { # 選擇elasticsearch elasticsearch { hosts => ['http://es-master:9200'] index => '%{[fields][service]}-%{[@metadata][version]}-%{+YYYY.MM.dd}' }}

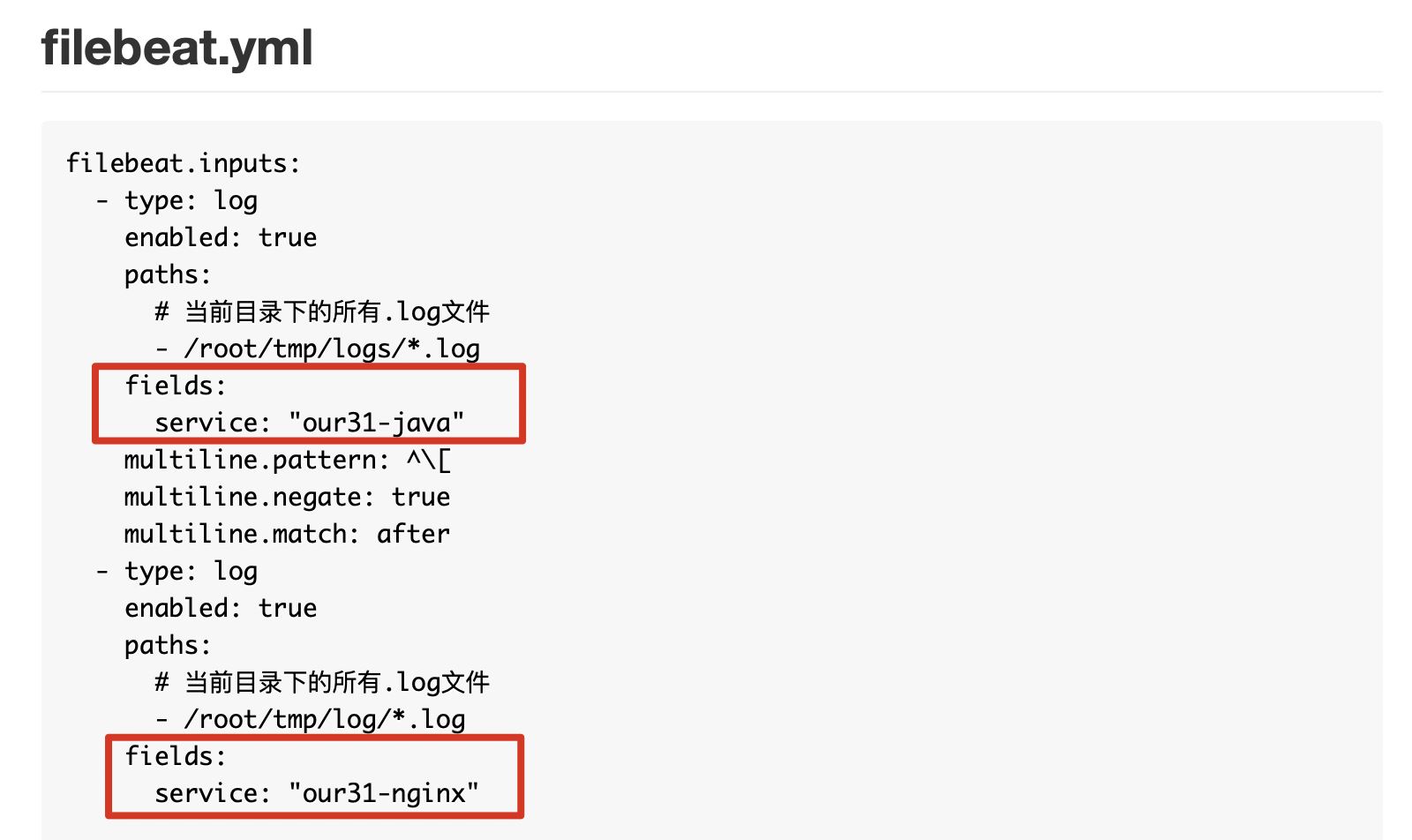

filebeat.yml

filebeat.inputs: - type: log enabled: true paths: # 當前目錄下的所有.log文件 - /root/tmp/logs/*.log fields: service: 'our31-java' multiline.pattern: ^[ multiline.negate: true multiline.match: after - type: log enabled: true paths: # 當前目錄下的所有.log文件 - /root/tmp/log/*.log fields: service: 'our31-nginx'filebeat.config.modules: path: ${path.config}/modules.d/*.yml reload.enabled: false# setup.template.settings:# index.number_of_shards: 1# setup.dashboards.enabled: false# setup.kibana:# host: 'http://localhost:5601'# 不直接傳輸至ES#output.elasticsearch:# hosts: ['http://es-master:9200']# index: 'filebeat-%{[beat.version]}-%{+yyyy.MM.dd}'setup.ilm.enabled: falseoutput.logstash: hosts: ['logstash.server.com:5044'] # Optional SSL. By default is off. # List of root certificates for HTTPS server verifications ssl.certificate_authorities: './ssl/ca.crt' # Certificate for SSL client authentication ssl.certificate: './ssl/client.crt' # Client Certificate Key ssl.key: './ssl/client.key'# processors:# - add_host_metadata: ~# - add_cloud_metadata: ~

注意

生成證書,配置 SSL,讓 Filebeat 與 Logstash 之間建立 SSL。

#生成ca私鑰openssl genrsa 2048 > ca.key #使用ca私鑰建立ca證書openssl req -new -x509 -nodes -key ca.key -subj /CN=elkCA CA/OU=Development group/O=HomeIT SIA/DC=elk/DC=com > ca.crt #生成服務器csr證書請求文件openssl req -newkey rsa:2048 -nodes -keyout server.key -subj /CN=logstash.server.com/OU=Development group/O=Home SIA/DC=elk/DC=com > server.csr #使用ca證書與私鑰簽發服務器證書openssl x509 -req -in server.csr -CA ca.crt -CAkey ca.key -set_serial 01 > server.crt #生成客戶端csr證書請求文件openssl req -newkey rsa:2048 -nodes -keyout client.key -subj /CN=filebeat.client.com/OU=Development group/O=Home SIA/DC=elk/DC=com > client.csr #使用ca證書與私鑰簽發客戶端證書openssl x509 -req -in client.csr -CA ca.crt -CAkey ca.key -set_serial 01 > client.crt

證書記得放到對應的文件夾中。

Filebeat 中 output.logstash.hosts 配置的域名要與證書相符。

根據不同服務器、不同服務、不同日期動態生成索引

上面的這張圖片中,加上了一些自定義屬性,這些屬性會傳遞到 Logstash 中,Logstash 會拿到這些屬性動態的向 Elasticsearch 中創建索引,如下圖:

詳細介紹看官方文檔,metadata,動態索引生成。

這里本來想使用 indices 來動態生成索引,但是根據官方配置,并沒有成功,哪位兄弟知道可以告知下為什么。

利用 Nginx Http Basic Authorization 讓 Kibana 需要登錄

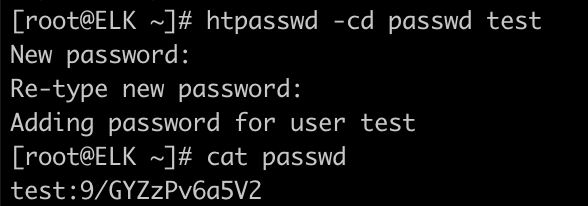

先使用工具 htpasswd 生成用戶信息

$ yum -y install httpd-tools

創建新密碼文件

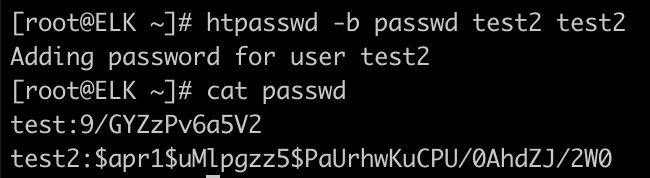

追加用戶信息:

最后配置好 Nginx 即可:

server { ...... auth_basic 'Kibana Auth'; auth_basic_user_file /usr/local/nginx/pwd/kibana/passwd; ......}

單獨啟動 Filebeat 的方式

$ nohup ./filebeat 2>&1 &啟動 Docker Compose

在 docker-compose.yml 所在目錄執行:

$ docker-compose up --build -d

到此這篇關于Docker Compose一鍵ELK部署的方法實現的文章就介紹到這了,更多相關Docker Compose ELK部署內容請搜索好吧啦網以前的文章或繼續瀏覽下面的相關文章希望大家以后多多支持好吧啦網!

相關文章:

網公網安備

網公網安備