Python爬取網頁信息的示例

Python爬取網頁信息的步驟

以爬取英文名字網站(https://nameberry.com/)中每個名字的評論內容,包括英文名,用戶名,評論的時間和評論的內容為例。

1、確認網址

在瀏覽器中輸入初始網址,逐層查找鏈接,直到找到需要獲取的內容。

在打開的界面中,點擊鼠標右鍵,在彈出的對話框中,選擇“檢查”,則在界面會顯示該網頁的源代碼,在具體內容處點擊查找,可以定位到需要查找的內容的源碼。

注意:代碼顯示的方式與瀏覽器有關,有些瀏覽器不支持顯示源代碼功能(360瀏覽器,谷歌瀏覽器,火狐瀏覽器等是支持顯示源代碼功能)

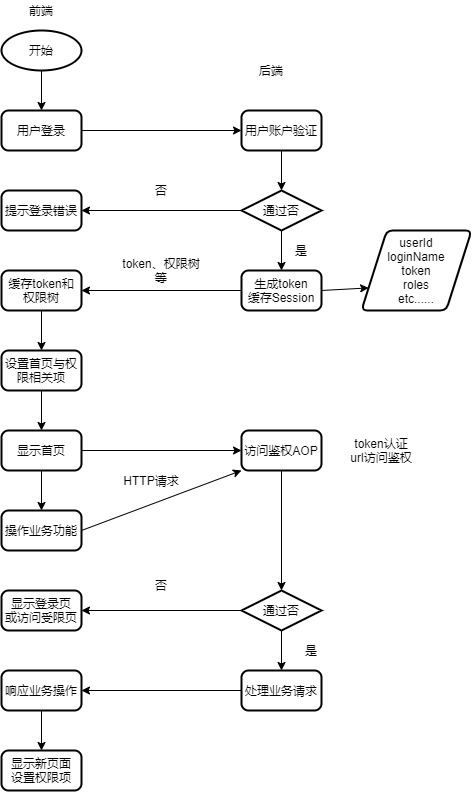

步驟圖:

1)首頁,獲取A~Z的頁面鏈接

2)名字鏈接頁,獲取每個字母中的名字鏈接(存在翻頁情況)

3)名字內容頁,獲取每個名字的評論信息

2、編寫測試代碼

1)獲取A~Z鏈接,在爬取網頁信息時,為了減少網頁的響應時間,可以根據已知的信息,自動生成對應的鏈接,這里采取自動生成A~Z之間的連接,以pandas的二維數組形式存儲

def get_url1(): urls=[] # A,’B’,’C’,’D’,’E’,’F’,’G’,’H’,’I’,’J’,’K’,’L’,’M’,’N’,’O’,’P’,’Q’,’R’,’S’,’T’,’U’,’V’,’W’,’X’,’Y’,’Z’ a=[’A’,’B’,’C’,’D’,’E’,’F’,’G’,’H’,’I’,’J’,’K’,’L’,’M’,’N’,’O’,’P’,’Q’,’R’,’S’,’T’,’U’,’V’,’W’,’X’,’Y’,’Z’]#自動生成A~Z的鏈接 for i in a: urls.append('https://nameberry.com/search/baby_names_starting_with/%s' %i) dp=pd.DataFrame(urls) dp.to_csv('A~Z_Link1.csv',mode='a',encoding=’utf_8_sig’)#循環用于在每個字母鏈接下,調用爬取名字鏈接的頁面的函數,即函數嵌套 for j in urls: get_pages_Html(j) return urls

2)獲取名字鏈接,根據網頁源碼分析出包含名字鏈接的標簽,編寫代碼,名字鏈接用直接存儲的方式存儲,方便讀取名字鏈接進行對名字的評論內容的獲取

#獲取頁數def get_pages_Html(url1): req = requests.get(url1) soup=BeautifulSoup(req.text)#異常處理,為解決頁面不存在多頁的問題,使用re正則表達式獲取頁面數 try: lastpage = soup.find(class_='last').find('a')[’href’] str1=’{}’.format(lastpage) b=re.findall(’d+’, str1 ) for page in b: num=page except: num=1 get_pages(num,url1) return numdef get_pages(n,url): pages=[] for k in range(1,int(n)+1): pages.append('{}?page={}'.format(url,k)) dp=pd.DataFrame(pages) dp.to_csv('NUM_pages_1.csv',mode='a',encoding=’utf_8_sig’) #函數調用 for l in pages: parse_HTML2(l) return pages# 名字的鏈接,根據網頁源碼的標簽,確定名字鏈接的位置def parse_HTML2(url2): try: req = requests.get(url2) req.encoding = req.apparent_encoding soup = BeautifulSoup(req.text) except: dp=pd.DataFrame(url2) dp.to_csv('Error_pages_1.csv',mode='a',encoding=’utf_8_sig’) name_data_l=[] error=[] li_list = soup.find_all(’li’,class_='Listing-name pt-15 pb-15 bdb-gray-light w-100pct flex border-highlight') try: for li in li_list: nameList=li.find(’a’,class_=’flex-1’)[’href’] name_data_l.append(’https://nameberry.com/’+nameList) time.sleep(1) cun(name_data_l,’Name_List_1’) except: dp=pd.DataFrame(name_data_l) dp.to_csv('Error_Name_List_1.csv',mode='a',encoding=’utf_8_sig’) # cun(url2,’Error_link_Q’) # dp=pd.DataFrame(name_data_l) # dp.to_csv('Name_List.csv',mode='a',encoding=’utf_8_sig’) # for i in name_data_l: # parse_HTML3(i) return name_data_l

3)獲取名字評論的內容,采用字典形式寫入文件

# 名字里的內容def parse_HTML3(url3): count=0 req = requests.get(url3) req.encoding = req.apparent_encoding soup = BeautifulSoup(req.text) error=[] try: Name=soup.find(’h1’,class_=’first-header’).find('a').get_text().replace(',','').replace('n','') except: error.append(url3) cun(error,'Error_Link_Comment') li_list = soup.find_all(’div’,class_='comment') for li in li_list: Title=li.find('h4').get_text().replace(',','').replace('n','') Time=li.find('p',class_=’meta’).get_text().replace(',','').replace('n','') Comments=li.find('div',class_=’comment-text’).get_text().replace(',','').replace('n','') dic2={ 'Name':Name, 'Title':Title, 'Time':Time, 'Comments':Comments } time.sleep(1) count=count+1 save_to_csv(dic2,'Name_data_comment') print(count) return 1

3、測試代碼

1)代碼編寫完成后,具體的函數調用邏輯,獲取鏈接時,為直接的函數嵌套,獲取內容時,為從文件中讀取出名字鏈接,在獲取名字的評論內容。避免因為逐層訪問,造成訪問網頁超時,出現異常。

如圖:

2)測試結果

4、小結

在爬取網頁內容時,要先分析網頁源碼,再進行編碼和調試,遵從爬蟲協議(嚴重者會被封號),在爬取的數據量非常大時,可以設置順序部分請求(一部分的進行爬取網頁內容)。

總之,爬蟲有風險,測試需謹慎!!!

以上就是Python爬取網頁信息的示例的詳細內容,更多關于Python爬取網頁信息的資料請關注好吧啦網其它相關文章!

相關文章:

網公網安備

網公網安備